python爬虫之url中的中文问题,,在python的爬虫

python爬虫之url中的中文问题,,在python的爬虫

在python的爬虫学习中,我们的url经常出现中文的问题,我们想要访问的url就需要对url进行拼接,变成浏览器可以识别的url

在python中已经有了这样的模块了,这就是urlencode

urlencode需要对中文和关键字组成一对字典,然后解析成我们的url

在python2中是

urllib.urlencode(keyword)

在Python中是

urllib.parse.urlencode(keyword)

查看一下代码:

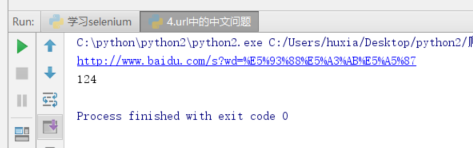

python2

import urllibimport urllib2#例如我们需要在百度上输入个关键字哈士奇进行查询,但是哈士奇是中文的,我们需要对哈士奇进行编码keyword = {"wd":"哈士奇"}head_url = "http://www.baidu.com/s"headers = { "User-Agent":"Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36"}wd = urllib.urlencode(keyword)url = head_url +"?"+ wdreq = urllib2.Request(url,headers=headers)response = urllib2.urlopen(req)html = response.read()print(url)print(html.count(‘哈士奇‘))结果如下:

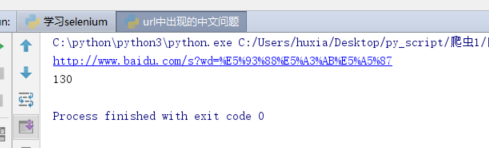

在python3中:

# -*- coding: utf-8 -*-# File : url中出现的中文问题.py# Author: HuXianyong# Date : 2018-09-13 17:39from urllib import requestimport urllib#例如我们需要在百度上输入个关键字哈士奇进行查询,但是哈士奇是中文的,我们需要对哈士奇进行编码keyword = {"wd":"哈士奇"}head_url = "http://www.baidu.com/s"headers = { "User-Agent":"Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36"}wd = urllib.parse.urlencode(keyword)url = head_url +"?"+ wdreq = request.Request(url,headers=headers)response = request.urlopen(req)html = response.read()print(html.decode().count("哈士奇"))print(url)结果如下:

如果需要吧转换的字符变成中文

可以用unquota

如下:

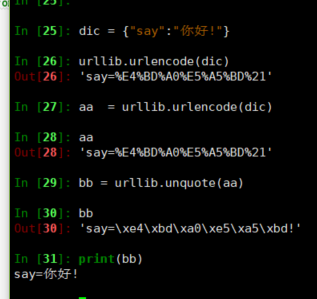

python2

In [25]: dic = {"say":"你好!"}In [26]: urllib.urlencode(dic)Out[26]: ‘say=%E4%BD%A0%E5%A5%BD%21‘In [27]: aa = urllib.urlencode(dic)In [28]: aaOut[28]: ‘say=%E4%BD%A0%E5%A5%BD%21‘In [29]: bb = urllib.unquote(aa)In [30]: bbOut[30]: ‘say=\xe4\xbd\xa0\xe5\xa5\xbd!‘In [31]: print(bb)say=你好!python3

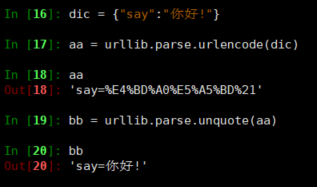

In [16]: dic = {"say":"你好!"}In [17]: aa = urllib.parse.urlencode(dic)In [18]: aaOut[18]: ‘say=%E4%BD%A0%E5%A5%BD%21‘In [19]: bb = urllib.parse.unquote(aa)In [20]: bbOut[20]: ‘say=你好!‘python爬虫之url中的中文问题

相关内容

- python内置函数和条件判断,python内置函数是什么,pytho

- 马老师曾说,我对钱没有兴趣!于是我用Python分析了马

- 使用Plotly来简化Python中的数据可视化,大数据可视化概

- 一文看懂Python的控制结构:For、While、If…都有了,如何

- 【Python初级-7】用户输入和while循环,,1、函数input(

- python join函数,join函数用法,1. join用法:

- Python两行代码实现一个计算器,html简易计算器代码,e

- python监控TCP连接数,,python监控TC

- Python format语法,python中format怎么用,a = {"name

- python接口自动化11-pytest入门,python接口自动化100例,前言

评论关闭