python写的一个squid访问日志分析的小程序,pythonsquid

python写的一个squid访问日志分析的小程序,pythonsquid

这两周组里面几位想学习python,于是我们就创建了一个这样的环境和氛围来给大家学习。

昨天在群里,贴了一个需求,就是统计squid访问日志中ip 访问数和url的访问数并排序,不少同学都大体实现了相应的功能,我把我简单实现的贴出来,欢迎拍砖:

日志格式如下:

复制代码 代码如下:

%ts.%03tu %6tr %{X-Forwarded-For}>h %Ss/%03Hs %<st %rm %ru %un %Sh/%<A %mt "%{Referer}>h" "%{User-Agent}>h" %{Cookie}>h

复制代码 代码如下:

1372776321.285 0 100.64.19.225 TCP_HIT/200 8560 GET http://img1.jb51.net/games/0908/19/1549401_3_80x100.jpg - NONE/- image/jpeg "http://www.bkjia.com/" "Mozilla/4.0 (compatible; MSIE 8.0; Windows NT 5.1; Trident/4.0; QQDownload 734; .NET4.0C; .NET CLR 2.0.50727)" pcsuv=0;%20pcuvdata=lastAccessTime=1372776317582;%20u4ad=33480hn;%20c=14arynt;%20uf=1372776310453

复制代码 代码如下:

#!/usr/bin/python

# -*- coding: utf-8 -*-

import sys

from optparse import OptionParser

'''

仅仅是一个关于日志文件的测试,统计处access.log 的ip数目

'''

try:

f = open('/data/proclog/log/squid/access.log')

except IOError,e:

print "can't open the file:%s" %(e)

def log_report(field):

'''

return the field of the access log

'''

if field == "ip":

return [line.split()[2] for line in f]

if field == "url":

return [line.split()[6] for line in f]

def log_count(field):

'''

return a dict of like {field:number}

'''

fields2 = {}

fields = log_report(field)

for field_tmp in fields:

if field_tmp in fields2:

fields2[field_tmp] += 1

else:

fields2[field_tmp] = 1

return fields2

def log_sort(field,number = 10 ,reverse = True):

'''

print the sorted fields to output

'''

for v in sorted(log_count(field).iteritems(),key = lambda x:x[1] , reverse = reverse )[0:int(number)]:

print v[1],v[0]

if __name__ == "__main__":

parser =OptionParser(usage="%prog [-i|-u] [-n num | -r]" ,version = "1.0")

parser.add_option('-n','--number',dest="number",type=int,default=10,help=" print top line of the ouput")

parser.add_option('-i','--ip',dest="ip",action = "store_true",help="print ip information of access log")

parser.add_option('-u','--url',dest="url",action = "store_true",help="print url information of access log")

parser.add_option('-r','--reverse',action = "store_true",dest="reverse",help="reverse output ")

(options,args) = parser.parse_args()

if len(sys.argv) < 2:

parser.print_help()

if options.ip and options.url:

parser.error(' -i and -u can not be execute at the same time ')

if options.ip :

log_sort("ip", options.number , True and options.reverse or False)

if options.url:

log_sort("url", options.number , True and options.reverse or False)

f.close()

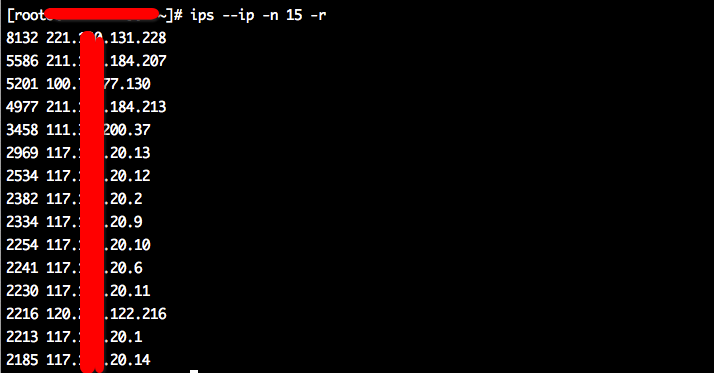

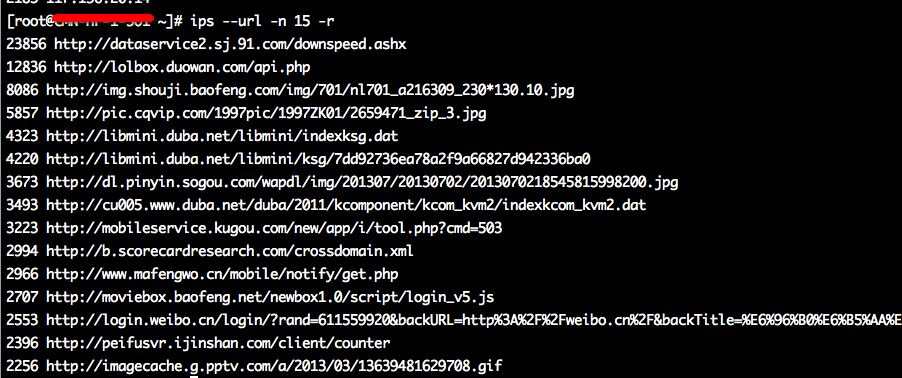

效果如下:

在squid的配置文件中可以禁止写日志,例如

cache_access_log /squid/logs/access.log

改为cache_access_log none

则squid不会再生成access日志。

如果你没在squid.conf里禁止,squid会写大量的日志文件。你必须周期性的滚动日志文件,以阻止它们变得太大。squid将大量的重要信息写入日志,假如写不进去了,squid会发生错误并退出。

可以使用如下命令

%squid -k rotate

来滚动日志记录。

例如,如下任务接口在每天的早上4点滚动日志:

0 4 * * * /usr/local/squid/sbin/squid -k rotate

该命令做两件事。首先,它关闭当前打开的日志文件。然后,通过在文件名后加数字扩展名,它重命名 cache.log,store.log,和access.log。例如,cache.log变成cache.log.0,cache.log.0变成 cache.log.1,如此继续。

其中,crontab是Linux下的定时进程,它会自动按照写入的时间定时执行程序。这个网上有很多资料可以查到它的用法。

至于squid,推荐你参考home.arcor.de/pangj/squid/

squid中文权威指南,大多数东西里边都谈到了

给你个思路

写个线程 去读日志 符合异常规则时将日志记录输出到页面

评论关闭