jieba 分词库(python),,安装jieba:pi

jieba 分词库(python),,安装jieba:pi

安装jieba:pip install jieba

原理:

基于前缀词典实现高效的词图扫描,生成句子中汉字所有可能成词情况所构成的有向无环图 (DAG)

采用了动态规划查找最大概率路径, 找出基于词频的最大切分组合

对于未登录词,采用了基于汉字成词能力的 HMM 模型,使用了 Viterbi 算法

分词:

jieba支持三种分词模式:

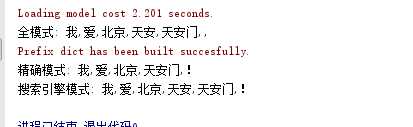

精确模式:试图将句子最精确地切开,适合文本分析

全模式:把句子中所有的可以成词的词语都扫描出来, 速度非常快,但是不能解决歧义

搜索引擎模式,在精确模式的基础上,对长词再次切分,提高召回率,适合用于搜索引擎分词

示例:

#!/usr/bin/python# -*- coding: UTF-8 -*-import jiebastrt = "我爱北京天安门!"# 全模式sl = jieba.cut(strt, cut_all=True)print("全模式:", ",".join(sl))# 精确模式,默认为精确模式,所以可以不指定cut_all=Falsesl = jieba.cut(strt, cut_all=False)print("精确模式:", ",".join(sl))# 搜索引擎模式sl = jieba.cut_for_search(strt)print("搜索引擎模式:", ",".join(sl))

关键词抽取算法主要有以下两种:

有监督学习算法:将关键词抽取过程视为二分类问题,先抽出候选词,然后对于每个候选词划定标签,其要么是关键词,要么不是关键词。然后训练关键词抽取分类器,当对一段新的文本进行抽取关键词时,先抽取出所有的候选词,然后利用训练好的关键词抽取分类器,对各个候选词进行分类,最终将标签为关键词的候选词作为关键词。

无监督学习算法:先抽取出候选词,然后对各个候选词进行打分,然后输出topN个分值最高的候选词作为关键词。根据打分的策略不同,有不同的算法,例如TF-IDF,TextRank等算法。

jieba分词实现了基于TF-IDF关键词抽取算法和基于TextRank关键词抽取算法,两类算法均是无监督学习的算法。以下对这两种算法进行介绍:

1.基于TF-IDF算法进行关键词抽取

jieba 分词库(python)

相关内容

- Python安装2 —— Pycharm2019.3.3的安装,vs2019安装勾选哪些

- python离线安装第三方requests类库,python和delphi哪个好,

- Ubutun18.04安装Python3.7.6,ubuntu自带python吗,最近因为环境

- 利用python爬取贝壳网租房信息,python爬虫接单网, 最近

- python学习之struct模块,,class stru

- python实现浏览器打开指定url,,关键webbrows

- Python Faker随机生成测试数据(干货),,前言 Faker是

- Python之让 字符串内的转义字符 不做任何处理,python转

- python3.6执行AES加密及解密方法,,python版本:3

- python接口测试-自动化测试报告生成。,,1. 首先创建r

评论关闭